Klick auf das Bild führt direkt zu den Heftdaten

Risszeichnung / Datenblatt

![]()

Klick auf das Bild führt direkt zur Zeichnung |

Spezifikationen:

Eintragsdatum:

03.06.2014 |

Letzte Änderung:

16.08.2019 |

Quellenliste:

Glossar

in PR-Heft:

2234 / 2298 / 2671 / 2819 / 3026 |

|

Alias

Unter »Hyperimpedanz« versteht man den hyperenergetischen Widerstand. Im Jahr 1331 NGZ wird deutlich, dass die Hohen Mächte des Universums diesen Widerstand erhöht haben - mit gravierenden Folgen für die meisten Völker der Milchstraße und zahlreicher anderer Galaxien, deren Technik auf der Nutzung von fünfdimensionalen Energien und des Hyperraums beruht.

Zumindest in den »unteren« Bereichen des hyperenergetischen Spektrums wird nun deutlich mehr Energie benötigt als früher, während gleichzeitig die erzielbaren Effekte schwächer werden. Verbunden damit sind hohe Materialbelastungen bis in den Bereich der Hyperkristalle. Zumindest für arkonidische und terranische Technik, die innerhalb der Milchstraße als führend gelten, sind die höheren Hyperfrequenzen kaum noch erreich - und nutzbar. Gewissermaßen als Begleiterscheinung der Hyperimpedanz - Erhöhung tobt seit 1331 NGZ eine erhöhte Anzahl sehr starker Hyperstürme durch die Milchstraße, worunter Raumfahrt und Fernkommunikation leiden. »Nebenwirkungen« von Hyperstürmen gleichen mitunter starken elektromagnetischen Pulsen und können auch konventionelle Technik lahm legen oder gar zerstören.

Im Mai 1312 NGZ warnt der Roboter Cairol die Terraner davor, dass die Kosmokraten den hyperphysikalischen Widerstand im gesamten Universum erhöhen werden, um die Ausbreitung des Lebens einzuschränken. Der hyperphysikalische Widerstand wird kurz Hyperimpedanz genannt. Er ist eine schon lange bekannte Funktion der Hyperfrequenz, die von verschiedenen Randbedingungen abhängig, also nicht konstant ist. Die Hyperimpedanz ist z.B. im Galaktischen Zentrum, wo die Sonnen besonders dicht stehen, stark erhöht und führt dort zu heftigen Hyperstürmen. Dass die Hyperimpedanz sich schon seit geraumer Zeit in allen Bereichen des Universums verändert, ist ebenfalls keine neue Information. Die Veränderungen waren jedoch bisher immer geringfügiger Natur. In den Jahren nach 1312 NGZ, insbesondere im September 1331, nehmen diese Veränderungen jedoch dramatisch zu. Im gesamten unteren Bereich des hyperenergetischen Spektrums (Frequenzbereich bis ca. 6,8 x 1013 Kalup) wird ein extremer Anstieg des Energieverbrauchs für die Erzeugung hyperenergetischer Wirkungen (die gleichzeitig immer schwächer werden) festgestellt. Die Bereiche des Hyperspektrums, in dem PSI-Kräfte angesiedelt sind, scheinen dagegen nicht betroffen zu sein. Den höchsten Wert erreicht die Hyperimpedanz am 11.09.1331 NGZ, danach ist kein weiterer Anstieg mehr messbar.

Die erhöhte Hyperimpedanz hat mehrere teils katastrophale Folgen im gesamten Universum:

1.: Jedes technische Gerät, das auf Hypertechnologie basiert, verbraucht bei stark verringertem Wirkungsgrad enorme Mengen von Energie, die verwendeten Hyperkristalle werden innerhalb kürzester Zeit "ausgelaugt", zerfallen zu Staub und müssen ausgetauscht werden. Am haltbarsten erweisen sich hierbei Khalumvatt-Kristalle. Die Benutzung von Transmittern für den Personenverkehr wird unmöglich, weil der Prozentsatz in Verlust geratener Sendungen extrem ansteigt. Ferntransmitter sind hiervon ganz besonders betroffen. Ähnliches gilt auch für Transformkanonen: Diese Waffen haben jetzt nur noch eine Reichweite von etwa einer Million Kilometern, das größtmögliche verwendbare Kaliber liegt bei nur 500 Megatonnen Vergleichs-TNT. Metagrav-Triebwerke können nicht mehr verwendet werden. Standard in der Raumfahrt sind künftig die alten Lineartriebwerke. Raumschiffe können Überlichtgeschwindigkeit nur noch mit extremem Energieaufwand erreichen und werden nach Etappen von maximal 50 Lichtjahren wieder in den Normalraum zurückgeschleudert. Der maximal mögliche Überlichtfaktor beträgt eine Million, erreicht wird in der Regel aber nur die Hälfte. Auch der Sublichtflug unterliegt Einschränkungen. Die Reichweite des Hyperfunks ist auf wenige Lichtjahre begrenzt, es müssen wieder Funkbrücken mit Relaisstationen eingerichtet werden. Somit sind alle Welten der galaktischen Großreiche zunächst isoliert, bis auf Alttechnologie umgestellt werden kann. Die auf interstellaren Warenaustausch gegründete Wirtschaft bricht zusammen, auf vielen Planeten herrscht das Chaos.

2.: Es ist nicht mehr möglich, Energie aus dem Hyperraum zu zapfen. Gravitraf-Speicher verlieren rapide an Speicherfähigkeit, es kommen wieder Kugel- und Ringspeicherbänke zum Einsatz. Die Energieversorgung wird künftig vorwiegend durch weiterentwickelte NUG-Schwarzschild-Reaktoren sichergestellt. Alle Syntroniken fallen komplett aus, NATHAN muss auf biopositronischen Betrieb umgestellt werden. Die Kristallschirme des Solsystems und Arkons fallen ebenfalls aus. Formenergie-Objekte und ähnliches werden wegen des gigantischen Energieverbrauchs nicht mehr eingesetzt.

3.: Heftige Raumbeben erschüttern insgesamt 10 über die ganze Galaxis verteilte Raumsektoren. Einer dieser Bereiche befindet sich in unmittelbarer Nachbarschaft zum Hayok-Sternenarchipel. Dort erscheinen am 02.09.1331 NGZ aus dem "Nichts" plötzlich Sterne und Sonnensysteme, bis der vormals leere Sektor von einem neuen Sternhaufen mit 220.000 Sonnenmassen ausgefüllt ist, dessen Sonnen das gleiche Alter haben wie diejenigen des Hayok-Sternarchipels. Die Sonnen waren im Hyperraum "versteckt" und fallen wegen der erhöhten Hyperimpedanz in den Normalraum zurück. Die neuen Sonnen sind zunächst ausschließlich hyperphysikalisch anmeßbar. Das ganze Gebiet steckt in einer Art hyperphysikalischem "Kokon", der sich allmählich dem Normalraum angleicht. Der Name des Sternhaufens ist Sternenozean von Jamondi. In unmittelbarer Nachbarschaft des ca. 500 Lichtjahre vom Solsystem entfernten Pfeifennebels erscheint nach heftigen Raumbeben ein weiterer Sternhaufen mit 65 Lichtjahren Durchmesser und 120.000 Sonnenmassen, der ebenso wie der Sternenozean von Jamondi noch in einem Hyperkokon hängt. Auch in Thantur-Lok, dem Kernbereich des Kristallimperiums, "rematerialisiert" eine Ansammlung von Sonnen, sie erhält den Namen "Dashkon Sternwolke".

4.: Hyperstürme treten als Sekundäreffekt der erhöhten Hyperimpedanz überall vermehrt auf und dauern erheblich länger als bisher. Sie erreichen bis dato unbekannte Stärken und übertreffen damit teilweise noch die Stürme, die vor Jahrzehntausenden die "Archaischen Perionden" Arkons eingeleitet haben. Durch diese überstarken Stürme werden immer wieder so genannte "Tryortan-Schlünde" aufgerissen, in denen jegliche Materie entstofflicht wird. Im Antares-Gebiet der Milchstraße entsteht das Sternenriff: Eine Zone schwerster und vor allem permanenter Hyperstürme, in der ein Manövrieren unmöglich ist. Sol verwandelt sich in ein kosmisches Leuchtfeuer und emittiert Strahlung mit einer sechsdimensionalen Komponente.

5.: Das Sternenfenster erlischt, so dass die Wurme der Aarus in der Milchstraße stranden

| Quellen: Glossareintrag in PR 2234 / 2298 / 2671 / 2819 / 3026 |

|

Hyperimpedanz ist der Fachausdruck für den hyperphysikalischen Widerstand, auch einfach Hyperwiderstand. Der Begriff Hyperimpedanz wird jedoch von vielen Galaktikern oft auch synonym für die katastrophalen Auswirkungen einer umfassenden und starken Erhöhung der Hyperimpedanz, der Hyperimpedanz-Erhöhung, genutzt.

Allgemeines

Die Hyperimpedanz bzw. der hyperphysikalische Widerstand ist eine der wesentlichen Kenngrößen der Hyperphysik im Standarduniversum. Diese Kenngröße ist keine Konstante. Die Hyperimpedanz beruht auf dem Wellenwiderstand des Hypervakuums, der bei höheren Frequenzen im Hyperspektrum deutlich geringer ausfällt als bei niedrigen Hyperfrequenzen. Entsprechend macht sich die Hyperimpedanz bei niedrigen Hyperfrequenzen deutlich stärker bemerkbar als bei höheren Frequenzen.

Da der Betrag der Hyperimpedanz den Wirkungsgrad hyperphysikalischer Prozesse und deren Verluste mitbestimmt, sind technische Geräte auf hyperphysikalischer Basis und Hyperkristalle von umso niedrigerem Wirkungsgrad, je niedriger ihre Schwing- und Arbeitsfrequenz im Hyperspektrum liegt. Das Bestreben jeder technischen Zivilisation liegt daher darin, bei möglichst hohen Frequenzen im Hyperspektrum zu arbeiten, um einen hohen Wirkungsgrad ihrer Apparaturen zu erreichen. Allerdings sind die technischen Herausforderungen bei höheren Hyperfrequenzen ungleich höher als bei niedrigen, so dass nur fortgeschrittenere Zivilisationen in diesem "bevorzugten" Bereich des Hyperspektrums (zum Beispiel im UHF-Bereich) arbeiten können. Der Grad der Fortschrittlichkeit einer Zivilisation wird daher auch oft über den Anteil der UHF- und SHF-Technologien bemessen.

Beeinflussungsmöglichkeiten

Es gibt vielfältige Möglichkeiten, die Hyperimpedanz und deren Betrag zu beeinflussen. Möglich ist dies auf lokaler, regional-galaktischer und universeller Ebene:

Lokale Ebene:

Einige hyperphysikalische Geräte sind in der Lage, lokal eine Art Hyperkavitation zu erreichen, die direkt auf den Wellenwiderstand des Hypervakuums wirkt. Im Einflussbereich einer Hyperkavitation sinkt die Hyperimpedanz deutlich und kann ansonsten nicht erreichbare niedrige Werte erreichen. Dadurch wird der Wirkungsgrad hyperphysikalischer Geräte zum Teil sehr deutlich gesteigert. Die lemurische Stoßimpuls-Generator-Plattform ZEUT-80 kann mit ihren Geräten eine Zone der Hyperkavitation erzeugen.

Andere hyperphysikalische Geräte erhöhen die Hyperimpedanz eher. Ein Beispiel dafür ist der Metagravantrieb, der bei hohen Überlichtfaktoren eine erhöhte Hyperimpedanz in seinem Wirkungsbereich induzierte. Dies trat zum Beispiel auf der JOURNEE auf.

Regionale/Galaktische Ebene:

Der Betrag der Hyperimpedanz variiert mit der Sterndichte. Im intergalaktischen Leerraum ist er niedrig, im galaktischen Zentrum dagegen höher. Dies kann durchaus 5-10% des Betrags der Hyperimpedanz ausmachen.

An bestimmten Stellen des Universums können Hypersenken mit abgesenkten Werten der Hyperimpedanz entstehen. (PR 2504) Über die Ursachen, Häufigkeiten und Beständigkeiten solcher Hypersenken kann keine Aussage getroffen werden.

Universelle Ebene:

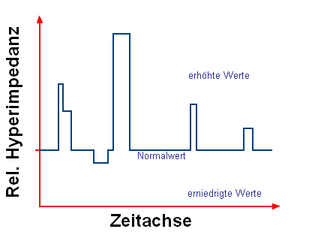

Prinzipskizze: Universumsweite Hyperimpedanzfluktuationen

Zufällige, universumsweite Fluktuationen sind nach Aussagen Homunks eine natürliche Ursache für veränderte Werte der Hyperimpedanz. (PR 2536)

Von den Vatrox ist bekannt, dass sie das PARALOX-ARSENAL und die darin gespeicherte Psi-Materie dazu nutzen wollten, die Hyperimpedanz über mehrere Galaxien hinweg (und möglicherweise im gesamten Universum) zu erhöhen und künstlich hoch zu halten. (PR 2536)

Nach Aussagen Cairols III kennen die Hohen Mächte Methoden, die Hyperimpedanz im gesamten Universum zu manipulieren und sowohl zu erhöhen als auch zu erniedrigen. (PR 2199) Über die dazu erforderlichen Mittel der Hohen Mächte ist nichts bekannt.

Im Bild sind Auswirkungen der universumsweiten natürlichen Fluktuation der Hyperimpedanz in einer Prinzipskizze dargestellt. "Fluktuationen" kennen keinen Maximalwert, die Hyperimpedanz kann daher in weiten Bereichen fluktuieren.

Hyperimpedanzschwankungen

In normalen Zeiten variiert die Hyperimpedanz nur sehr begrenzt, so ist in galaktischen Zentren mit einer höheren Hyperimpedanz zu rechnen, als in sternenarmen Regionen. Dies bedeutet einerseits, dass stationäre Geräte auf Planeten auf fixierte Werte der Hyperimpedanz (Ein-Hyperimpedanz-Geräte) ausgelegt werden können, während vor allem Raumfahrttechnik auf Schwankungen der Hyperimpedanz ausgelegt werden muss (Multi-Hyperimpedanz-Geräte), damit die Technik nicht nur in sternenarmen Regionen funktioniert, sondern auch in Regionen wie zum Beispiel Kugelsternhaufen. Solche Toleranzen haben dann ihre Grenzen, wenn es durch äußere Einflüsse zu regionalen oder universumsweiten Hyperimpedanzänderungen kommt. Diese können im extremsten Fall Auslöser einer Hyperimpedanz-Erhöhung sein.

Allgemeine Folgen von Hyperimpedanz-Erhöhungen (bzw. Hyperimpedanzerniedrigungen):

Der Wirkungsgrad technischer Geräte im Frequenzbereich unterhalb 6,8×1013 Kalup erniedrigt (bzw. erhöht) sich. Dies kann bis zum Totalausfall der Geräte führen.

Der Energiebedarf hyperphysikalischer Geräte erhöht (bzw. erniedrigt) sich, wobei gleichzeitig der Wirkungsgrad energieerzeugender Geräte sinkt (bzw. steigt).

Die Eigenschaften von Hyperkristallen können sich deutlich ändern, es kann (muss aber nicht) zu erheblichen Auslaugungserscheinungen von Hyperkristallen kommen.

Für bestimmte technische Prozesse müssen andere Hyperkristalle / Hyperkristalltypen eingesetzt werden, da sich die Schwingungseigenschaften der auch Schwingquarze genannten Hyperkristalle verändern.

Großmaßstäbliche Hyperimpedanz-Erhöhungen erzeugen vermehrt auftretende Hyperstürme, deren Heftigkeit ebenfalls zunehmen kann. Bei extremen Hyperimpedanz-Erhöhungen kann dies zur Ausbildung von Tryortan-Schlünden und großmaßstäblichen Ortsversetzungen kosmischer Gebilde kommen. Diese können bei lokalen Besonderheiten in bestimmten Gebieten (wie Zentren von Galaxien) deutlich heftiger / stärker ausfallen.

Hyperimpedanz-Erhöhung

Großräumige und sehr starke Erhöhungen des Betrags der Hyperimpedanz erzeugen in den betroffenen Bereichen einen vielfältigen Ausfall von Hyperkristallen und von Technik, die im niedrigen Frequenzbereich des Hyperspektrums arbeitet. Damit verbunden ist im schlimmsten Fall der totale Zusammenbruch galaktischer Zivilisationen, die komplette Entwertung der für die Hypertechnik zwingend erforderlichen Hyperkristalle und das Auftreten extremer Naturereignisse wie eine Zunahme sehr starker Hyperstürme sowie von Tryortan-Schlünden. Diese Folgen einer starken Erhöhung der Hyperimpedanz werden gesammelt als Hyperimpedanz-Erhöhung bezeichnet. Nicht jedes Volk und jeder Bereich des Universums ist jedoch von den Auswirkungen einer Hyperimpedanz-Erhöhung gleichermaßen betroffen, so dass das Vorliegen einer Hyperimpedanz-Erhöhung nicht an eine bestimmte Erhöhung der Hyperimpedanz gebunden ist.

Die zehn Millionen Jahre alte Frequenz-Monarchie war in vier Zeiten der Hyperimpedanz-Erhöhung, die sie als Erste, Zweite, Dritte und Vierte Hyperdepression bezeichnete, aktiv.

| Quellen: PR 2199, PR 2200, PR 2202, PR 2211, PR 2370, PR 2398, PR 2504, PR 2569 |

|

|

Verweise:

|

| Dazugehöriger Kommentar von Rainer Castor: Der erhöhte Hyperwiderstand (I) |

Geoffry Abel Waringer, anfänglich verkannt und ausgelacht, wurde in seiner wissenschaftlichen Arbeit vor allem geprägt durch die Konfrontation der terranischen Hyperphysik mit der Paratrontechnologie im Dolan-Krieg des 25. Jahrhunderts. Auch mit Blick auf die späteren Forschungen und Ergebnisse eines Payne Hamiller muss hervorgehoben werden, dass von Waringer einige durchaus als bahnbrechend zu bezeichnende Veröffentlichungen stammten. Diese,fanden allerdings unter dem Pseudonym Schneider Eingang in die wissenschaftliche Literatur. Die BegründungfürWaringers Vorgehen warebenso einfach wie verständlich. Er selbst war Ende der 20er und zu Beginn der 30er Jahre des 25.Jahrhunderts vom wissenschaftlichen Establishment weder in Person noch Reputation anerkannt. Er fiel stattdessen wegen einiger gewagter Theorien auf und »floh« Mitte 2429, weil ausgelacht, von der Erde, statt einen Gastvortrag an der Raumakademie Terrania zu halten (PR-Roman 333, PR-Taschenbuch 88).

Ein Einreichen und Prüfen von Arbeiten über die lunare Hyperinpotronik NATHAN bescherte also ein unverfängliches exomine-Siegel. Dass die Wahl des Namens Schneider mit Blick auf das Grimm-Märchen vom »Tapferen Schneiderlein« erfolgte, war später eine viel kolportierte Anekdote, wurde allerdings von Waringer niemals bestätigt oder gar überhaupt kommentiert. Tatsache war jedoch, dass schon nach der Veröffentlichung des ersten Beitrags am 18. Juli 2432 unter den Wissenschaftlern eine rege Diskussion begann, wie die Regeln der Schneider'schen Mechanik auszulegen seien. Diese Mechanik befasste sich vor allem mit höchstfrequenten, mehr oder minder »psionischen« Bereichen des hyperenergetischen Spektrums. Solche Signale gehorchten den Regeln der Schneider'schen Mechanik, wie die Gesamtheit der Phänomene des fünf-plus-dimensionalen Universums nach dem Theoretiker benannt wurde, der... erste, tastende Versuche unternommen hatte, sie formelmäßig zu erfassen ... Die fünfdimensionale Ausstrahlung von Hypersendern unterlag einer Beschränkung hinsichtlich der Reichweite ... Schneider'sche Strahlung war solchen Einschränkungen wahrscheinlich nicht unterworfen... (PR 368)

Wie zwischenzeitlich erkannt wurde, stieg die Reichweite hyperenergetischer Strahlung, die über weite Strecken des Spektrums konstant war, in der Tat im UHF-und oberhalb davon im SHF-Bereich dramatisch an. Begründet wurde dies mit einer Veränderung des Phänomens, das Hyperphysiker »Wellenwiderstand des Hypervakuums« nannten und als eine Funktion der Hyperfrequenz angesehen wurde (PR 1464, 1429). Ein zweiter Beitrag der Schneider'schen Mechanik war die so genannte Dimensionsgitterkonstonte (PR 368), von der Payne Hamiller später die Strangeness ableitete. Der Hyperwiderstand als solcher war seit langem bekannt. Es handelt sich hierbei nicht um eine Konstante, sondern um einen von vielen hyperphysikalischen Randbedingungen abhängigen Wert. Lokal erhöhte oder stark schwankende Werte fanden sich stets in Gebieten hoher Sterndichte, verbunden mit den für diese Bereiche wie das Galaktische Zentrum typischen Hyperstürmen.

Hyperwiderstand ist die allgemeine Umschreibung; der Fachbegriff der Wissenschaftler lautet »hyperphysikalische Impedanz«, kurz »Hyperimpedanz« (Impedanz. »verstricken, hemmen«; in der konventionellen Technik der »frequenzabhängige Widerstand« eines Bauteils oder Systems, gemessen in Ohm, zum Beispiel als Angabe bei Lautsprechern). Die seit Jahren permanent vorgenommenen Messungen zeigten eine zunächst kaum merkliche Veränderung von Naturkonstanten des Hyperkontinuums, die allerorten gleich ausfiel und - wie die Nachrichten aus Tradom zeigten - in der Tat universumweit beobachtet werden konnte. Bestimmungen des Meganon-Faktors zeigten überdies, dass die Kalup-Hef-Korrelation offenbar immer weiter auseinander klaffte - verbunden mit noch nicht absehbaren Folgen.

Interessant könnte in diesem Zusammenhang aber unter Umständen zu sein, dass schon seit einigen Jahren sonderbare »Quintronen-Oszillationen« beobachtet werden, bei denen sich die Quanten der Hyperenergie in bislang so noch nicht angemessener Weise verändern und umwandeln. Hef- und Kalup-Werte wechseln hierbei ebenso spontan und willkürlich wie der Meganon-Faktor, und häufig verschwinden die Quintronen sogar komplett oder wechseln in »Bereiche«, die die Messgeräte nicht erfassen. Die Zusammenhänge, vor allem mit Blick auf die erhöhte Hyperimpedanz, sind leider noch völlig unklar

| Quellen: PR-Heft Nummer

2211 |

|

| Dazugehöriger Kommentar von Rainer Castor: Der erhöhte Hyperwiderstand (II) |

Schon um 430 NGZ hatte sich Geoffry Abel Waringer mit dem Versuch beschäftigt, das hyperenergetische Spektrum als Flächendiagramm darzustellen, weil es seit jeher Hyperkräfte und -wirkungen gibt, die sich in ihrer Wirkung grundlegend unterscheiden, obwohl ihnen die gleiche Hyperfrequenz zugeordnet wird. Ein Phänomen, das seit der Einführungdes Kalups neben dem Hef (hyperenergy equivalentfrequency] als Einheit immer wieder für Verwirrung sorgte. Kalup-Hyperfrequenzen oberhalb von eins kommen einerseits nur als ganzzahlige Werte vor, während das für die Hef-Skala nicht gilt. Andererseits ergibt die gleichzeitige Bestimmung von Kalup und Hef mitunter Werte, die nicht in direkter Korrelation zueinander stehen. Hyperbarie auf der Hef-Skala kann bei gleichzeitiger Messung also durchaus Hyper-Psi auf der Kalup-Skala bedeuten. Diese »zusätzliche Eigenschaft« des hyperenergetischen Spektrums wird mit dem nach Attaca Meganon benannten Meganon-Faktorverbunden und kann mit Hilfe des Hyperraum-Resonators nachgewiesen werden.

Als konventioneller Vergleich kann die Verknüpfung von Volumen, Temperatur und Druck eines Gases herangezogen werden. Ist einer der drei Werte konstant -beispielsweise der Druck unter Normalbedingungen-, folgt aus der Änderung eines der beiden automatisch die des zweiten. Dass der dritte Wert keineswegs immer konstant sein muss und Auswirkungen auf die anderen hat, zeigt sich beispielsweise, wenn man auf einem hohen Berg Wasser zum Kochen bringt - weil hier der Atmosphärendruck geringer ist, sinkt auch der Siedepunkt des Wassers. Wird dagegen der Druck erhöht, gilt dies auch für den Siedepunkt, der nun überder »normalen« Siedepunkttemperaturvon 100 Grad Celsius liegt. Die Frequenzen eines HÜ-Schirms befinden sich auf der Kalup-Skala beispielsweise im Bereich um 40.000 Kalup. Somit galten Halbraumeffekte als solche, die »nicht weit« in den Hyperraum hineinreichten, und wurden mit der ursprünglichen Definition als »Librationszone zwischen vierter und fünfter Dimension« verbunden.

Weil jedoch ein breites Band der Hef-Frequenzen ebenfalls einbezogen werden muss, ergibt die Kombination ein deutlich breiteres und vielfältigeres Wirkungsspektrum. In der Praxis lassen sich somit hyperelektromagnetische Halbraumeffekte ebenso erzielen wie solche der Hypergravitation. Ersteres kam beim Halbraumspürer zum Einsatz und erklärte, warum es so schwierig war, überhaupt im Halbraum passable Ortungsergebnisse zu erzielen, Letzteres war vor allem Einsatzbereich des HÜ-Schirms und stand für die Schwierigkeiten, die das Halbraumfeld zunächst verursachte, bis seine Struktur erkannt wurde und zur verbesserten Version des terranischen HÜ-Schirms führte. Eine Analogie kann den Zusammenhang vielleicht ebenfalls verdeutlichen. Wasser besteht aus Wasserstoff und Sauerstoff. Werden beide als H2- und 02-Moleküle gemeinsam in einen Behälter gefüllt, entsteht erst durch die Zufuhr einer so genannten Aktivierungsenergie, welche H2 und 02 miteinander reagieren lässt, das energetisch günstiger liegende H20. Mit anderen Worten. Beim Einsatz einer entsprechenden »Hyperaktivierungsenergie« ließen sich schon immer Effekte erzielen, die unter dem Strich eine günstigere Bilanz ergaben. Weil die zugrunde liegenden Zusammenhänge unbekannt waren, schob man es auf den Hyperraum und nannte es lapidar »Störgeräuschpegel«, »Überreichweiten« oder »Hyperwiderstand«.

Nun aber wird allgemein für die Erzeugungvon hyperenergetischen Wirkungen im Hyperfrequenzbereich bis etwa 6,8x 1013 Kalup ein signifikanter Anstiegder dazu benötigten Energiemenge bei gleichzeitig beschleunigter Auslaugung der verwendeten Hyperkristalle festgestellt. Diese sind jedoch die Grundlage aller Geräte auf Hyperbasis und zeigen somit insgesamt einen deutlich reduzierten Wirkungsgrad. Allgemein muss mit einem größeren Energieaufwand im gesamten unteren Bereich des hyperenergetischen Spektrums ausgegangen werden, umschrieben als »hyperresistorische Energieschwelle« - wobei unklar ist, ob sich diese bei einem festen Wert einpendelt. Absolutes Worst-case-Szenario wäre die völlige Unbrauchbarkeit der Hyperkristalle und damit das Ende aller galaktischen Zivilisation. Dass das nicht an den Haaren herbeigezogen ist, zeigt der Blick in die Vergangenheit. Vergleichbares wurde seinerzeit schon in den Archaischen Perioden beobachtet, in denen für Jahrtausende sämtliche Geräte auf Hyperbasis versagten. Aber auch die Toten Zonen der Hyperraumparese können als Vergleich herangezogen werden ...

| Quellen: PR-Heft Nummer

2212 |

|

| Dazugehöriger Kommentar von Rainer Castor: Der erhöhte Hyperwiderstand (III) |

Das Grobschema des hyperenergetischen Spektrums an sich scheint- unter Berücksichtigungder mit dem Meganon-Faktor verbundenen Erweiterungen - nach wie vor gültig zu sein. Für alle unteren Bereiche auf Hef- und Kalup-Skala wird jedoch deutlich mehr Energie benötigt, während gleichzeitig die erzielbaren Effekte reduziert oder erschwert sind. Verbunden damit sind hohe Materialbelastung allgemein sowie ein beschleunigter Zerfall der Hyperkristalle. Die größere Belastung bedingt eine erhöhte Auslaugung, was wiederum Reichweiten- und eine Effektbegrenzung nach sich zieht. Leider sind Hyperkristalle die Grundlage aller Aggregate auf hyperphysikalischer Basis, die folglich einen reduzierten Wirkungsgrad aufweisen. Die höheren Hyperfrequenzen ab dem UHF-Bereich waren auch früher schon für die terranische Wissenschaft und Technik schwer zugänglich. Diese Bereiche des Spektrums sind nun noch weit schwerer zu erreichen oder technisch auszunutzen. Bei den Parakräften und Mutantenfähigkeiten dagegen scheint alles beim Alten geblieben zu sein. Guckt', Startac Schroeder oder Trim Marath sind in ihren Talenten nicht beeinträchtigt.

Die UHF- und SHF-Technik, aber auch sechsdimensionale Anwendungen und dergleichen sind aus der High Tech weitestgehend verschwunden. Nach Myles Kantors natürlich noch nicht bestätigter Meinung wird man sie fortan wohl bestenfalls noch bei Superintelligenzen, Kosmokratenbeauftragten und ähnlichen »Hausnummern« antreffen. Zu den allgemeinen Auswirkungen der erhöhten Hyperimpedanz gehört ein vermehrtes Auftreten deutlich stärkerer und länger andauernder Hyperstürme, die mitunter Hyperwie Normaltechnik komplett lahm legen können. Noch auf Camelot wurde als Maß für die Hypersturmstärke als neue Einheit die nach oben offene Meganon-Skala eingeführt - »Meg« abgekürzt. Als Durchschnittswert galten bislang rund 2? Meg, pro Jahr wurden nur wenige Hyperstürme angemessen, die Werte bis zu 50 Meg erreichten. Selbst der gewaltige Hypersturm Skorgon Taion (Verschleierter Riese) in der Nacht vom 8. auf den 9. März 1246 NGZ erreichte »eben mal« 117,4 Meg.

Seit rund einem Jahr ist dagegen eine Stärke von rund 50 bis 80 Megschon fast »normal«, während dervon Thantur-Lok bis zur Milchstraßenhauptebene reichende Orkan zwischen Werten von 90 bis zu 125 Meg pendelt. Lokale Einzelspitzen erreichen sogar bis zu 150 Meg - und noch ist kein Ende abzusehen ... Myles Kantor hält die Stürme zwar eher für »Anpassungsturbulenzen«, aberwie lange sie in dieserForm auftreten werden, bleibt vorerst offen. Mit einigen hundert Jahren muss jedoch durchaus gerechnet werden. Zu unterscheiden sind die Primäreffekte der erhöhten Hyperimpedanz selbst von den Sekundäreffekten der Hyperstürme. Beide können sich gegenseitig aufschaukeln, mit der Folge, dass unter Umständen gar nichts mehr funktioniert - bis hin zu extremen Verzerrungen der Raum-Zeit-Struktur und absonderlichsten Phänomenen. »Nebenwirkungen« von Hyperstürmen gleichen mitunter einem starken EMP, also einem elektromagnetischen Puls, und können auch konventionelle Technik und Geräte lahm legen oder zerstören. Weiterhin gibt es mit den gehäuft erscheinenden Tryortan-Schlünden ein Phänomen, das nur bei starken Hyperstürmen auftritt. Es stellt sich als eine Art »Öffnung ins Nichts« dar, durch die sämtliche Materie mit unbekanntem Ziel entstofflicht und somit einer Zwangstransition unterworfen wird oder aber in der Art eines Paratronaufrisses im übergeordneten Kontinuum »verweht«.

Besonders häufig wurden Tryortan-Schlünde zu Beginn und am Ende der Archaischen Perioden beobachtet; aus dieser Zeit stammt auch der Ausruf. »Bei allen Dämonen des Tryortan-Schlundes!« Als markanteste Auswirkung der erhöhten Hyperimpedanz muss der massiv reduzierte maximal erreichbare Überlichtfaktor genannt werden. Was zunächst mit einer prozentualen, aggregatabhängigen Verringerung begonnen hatte, läuft auf einen generellen mit der vertrauten Technik erreichbaren Grenzwert hinaus - unabhängig davon, ob Metagrav- oder Lineartriebwerke zum Einsatz kommen. Auf welchen ÜL Faktor sich dieser Grenzwert einpendeln wird, ist unbekannt. Auch hier muss das absolute Worst-case-Szenario einkalkuliert werden - das völlige Versagen aller Überlichttriebwerke. Ob Forschungen zu technischen Alternativen auf längere Sicht Ersatz bieten können, muss derzeit offen bleiben. Gleiches gilt für alle anderen Behinderungen, mit denen man zu kämpfen hat und auf die noch gesondert eingegangen wird

| Quellen: PR-Heft Nummer

2213 |

|

| Dazugehöriger Kommentar von Rainer Castor: Folgen der erhöhten Hyperimpedanz (I) |

Syntroniken sind im gesamten Solsystem, vermutlich jedoch überall im Universum, komplett unbrauchbar geworden und haben allenfalls noch Materialwert - was schon im Solsystem zu einem ungeheuren Austausch- und Erneuerungsbedarf führt. Allein die militärischen Sektoren sind weitreichend von der Positronik-Industrie beliefert. Der zivile Sektor dagegen leidet ungeheuren, in seiner Breite noch nicht absehbaren Mangel. Zwar wurde im Zuge der KorraVir-Gefahr die Positronik- oder Posyn-Hybrid-Produktion schon beträchtlich forciert, aber nun steht ein Komplettersatz sämtlicher syntronischer Systeme bevor. Positroniken und Biopositroniken müssen als allgemeiner Standard erst wieder etabliert werden; beide Rechnersystem liegen allerdings in Mikro- und Nanobauweise vor. Die terranische und galaktische Technik kann keine Hyperzapfung mehr durchführen. Es gelingt nicht mehr, energetisch ausreichend höherwertige Kontinua des Hyperraums anzuzapfen - unabhängig davon, ob es sich um Standard-Hypertropzapfer handelt oder solche nach dem Lieberman-Permanentprinzip. Energie liefern fortan vor allem Fusionskraftwerke -die Reaktoren gibt es seit Jahrtausenden in Mikro- und Großbauweise und ebenso robuster wie bewährter Ausführung.

Bei den Nugas-Schwarzschildreaktoren (NSR), die als ausgesprochene Großgeräte anzusehen sind, wurden dagegen schon gefährliche Fesselfeld-Fluktuationen in den Nugas-Speicherkugeln beobachtet, so dass fortan eine geringere Beladung statt der bislang üblichen 200.000 Tonnen ratsam erscheint. Nugas steht hier für Nukleares Gas und umschreibt ein nur aus Protonen bestehendes Plasma. Die genormten Standard-Brennstoffbehälter haben einen Durchmesser von zwölf Metern. Im Inneren befinden sich extrem starke Generatoren für das Koma-Verdichtungsfeld, das das Nugas komprimiert und von seiner Umgebung abschirmt. Ohne dieses Schutzfeld würden die Protonen sofort explosionsartig auseinander streben und alles in ihrer Umgebung zerstören! Die eigentliche Nugas-Kugel erreicht netto »nur« 2,2 Meter Durchmesser; in den 5,8 Kubikmetern wird fortan die Masse von 50.000 Tonnen gelagert. Das restliche Volumen des Behälters ist angefüllt mit technischen Geräten zur Aufrechterhaltung und Erzeugung des Fesselfeldes, Antigravprojektor en und Inertern. Hinzu kommt ein autarker Energiesl,- ei¬cher, der die Aggregate etwa fünf Minuten in Betrieb halten kann, falls die externe Stromversorgung nicht angeschlossen ist.

Gravitrafspeicher sind nur noch bedingt einseti,bar und in ihrem »Speichervolumen« beschränkt oder benötigen entsprechend lange, um über die Normalkraftwerke aufgeladen zu werden. Wie zur Zeit des Solaren Imperiums muss verrriehrt auf Kugel- und Ringspeicher zurückgegriffen werden -Sphärotraf und Zyklotraf genannt und zu Speicherbänken zusammengefasst, deren Wirkungsgrad deutlich geringer als bei den Gravitrafs ausfällt. Nachteil ist unter anderem, dass in den Gravitrrfs vor allem bedarfsgerecht vom Hypertrop gezapfte Hyperenergie gespeichert wurde, die direkt zu den Endverbrauchern weitergeleitet werden konnte, während nun Wandler und Transformer mit den unweigerlichen Verlusten zwischengeschaltet werden müssen. Folge der eingeschränkten Energieversorg ung ist auch, dass Formenergie-Objekte oder Materieprojektionen kaum mehr eingesetzt werden.

Bei Raumschiffen ist die Hyperfunkreichirreite auf fünf Lichtjahre reduziert. Planetare Großfu nkstationen haben eine größere Reichweite, benötigen allerdings viel mehr Energie. Ein Kontakt Terra -Arkon ist also bis auf weiteres nur über entsprechen de Relaisstationen oder per Kurier möglich. Vom galaxisumspannenden GALORS-Netz gibt es derzeit keine Rückmeldung, es dürfte komplett zusammengebrochen sein. Die Cantoro-Technik arbeitete zwar zum Teil sogar im SHF-Bereich des hyperenergetischen Spektrums, aber auch diese gibt den Geist auf, sobald die Energieversorgung zusammenbricht oder »primitive« Steuertechnik auf Syntronbasis ausfällt …

Gleiches gilt derzeit für die terranischen Satelliten-und Relaisnetze, die erst zum Teil auf Posyn-Hybrid-Technik umgestellt wurden. Möglicherweise gelingt es in den kommenden Wochen, einen Teil der nach wie vor über das All verteilten Alt-Satelliten per Hyperfunk-Fernsteuerung aus ihrem Sleep-Zustand wieder ins Leben zu rufen. Ein paar hundert oder tausend Jahre sind schließlich für einen robust ausgelegten Satelliten im freien Raum noch kein Greisenalter

| Quellen: PR-Heft Nummer

2216 |

|

| Dazugehöriger Kommentar von Rainer Castor: Folgen der erhöhten Hyperimpedanz (II) |

Metagrav-Triebwerke funktionieren nicht mehr, da sich ein Pseudo-Black-Hole als Metagrav-Vortex in Verbindung mit der Grigoroffschicht als zu energieaufwendig herausgestellt hat. Die Ausfallwahrscheinlichkeit ist überdies extrem erhöht - Störungen aufgrund der Hyperimpedanz verbinden sich mit der Gefahr, in irgendwelchen Universen herauszukommen. Es bringt also nichts, diese Triebwerke weiterhin einzusetzen, weil ineffizient und zu gefährlich. Das alte Halbraum- oder Lineartriebwerk wird wohl bald wieder Basisaggregat. Die Bezeichnung »Linear« beruht darauf, dass bei den Einzeletappen das jeweilige Flugziel als so genannter Zielstern direkt angepeilt und geradlinig, also linear, angeflogen wird. Leider gibt es auch hier massive Einschränkungen. Die Etappenreichweite liegt bei etwa fünfzig Lichtjahren, der maximale Überlichtfaktor bei einer Million, was einer Geschwindigkeit von 114,2 Lichtjahren pro Stunde oder 82.190 Lichtjahre in dreißig Tagen entspricht.

Als Standardwert gilt jedoch ein noch viel kleinerer ÜLFaktor von 500.000 gleich 0,95 Lichtjahre pro Minute oder 57,1 Lichtjahre pro Stunde. Für eine Fünfzig-Lichtjahre-Etappe ist also mit Orientierung und Ortung eine Stunde anzusetzen. In Gebieten mit sehr hoher Sternendichte reduziert sich der einsetzbare ÜL Faktor noch weiter nach unten. Die für einen Linearflug »auf Sicht« Richtung eines Zielsterns obligatorische Erfassung auf »paraoptischer Basis« funktioniert zumindest eingeschränkt. Da Ortung und Tastung auf Hyperbasis allgemein in der Reichweite eingeschränkt oder behindert sind, gilt dies selbstverständlich auch für die »paraoptische« Erfassung. Die derzeit eingeschränkte Etappenreichweite ist - neben anderen Faktoren unmittelbare Folge. Ein Zielstern in 1000 Lichtjahren Entfernung kann momentan gar nicht auf diese Weise erfasst werden. Die Kursänderung auf einen anderen Zielstern während des Fluges muss unter den veränderten Bedingungen als zu risikoreich eingeschätzt werden, weil mit der Gefahr verbunden, vollständig die Orientierung zu verlieren - gleichbedeutend mit einem vorzeitigen Etappenende und dem Rücksturz ins Standarduniversum.

Die erreichbare Sublichtbeschleunigung liegt momentan im Bereich zwischen zehn und hundert Kilometern pro Sekundenquadrat - Letzteres bedeutet beispielsweise, dass zehn Prozent der Lichtgeschwindigkeit in 300 Sekunden erreicht werden, fünfzig Prozent der Lichtgeschwindigkeit in 1500 Sekunden sprich 25 Minuten. Für den Sublichtflug können Protonenstrahl-Impulstriebwerke, aber auch Gravotron-Feldtriebwerke eingesetzt werden, wie sie in den letzten Jahrzehnten in verbesserter Ausführung beim Einsatz gravomechanischer Kraftfelder für Beschleunigung und Richtungswechsel entwickelt wurden. Das Gravotron-Feldtriebwerk, kurz Gravotron, wird auch als sceersches Hyperfeldtriebwerk bezeichnet und wurde nach Kaha da Sceer benannt, dem Senior-Chefingenieur und Leiter der Abteilung Triebwerk und Bordmaschinen der TRAJAN. Vergleichbare Einschränkungen gelten auch für den Einsatz von Transmittern, die sich als extrem störanfällig erwiesen haben und derzeit offensichtlich auf eine Fünfzig-fünfzig-Chance eines gelungenen Transports zuzusteuern scheinen.

Kleinere Transmitter-Verkehrsnetze wie auf Terra könnten zwar theoretisch betrieben werden, benötigen aber eine gegen früher rund 20fach höhere Energieversorgung - bei gleichzeitig extrem eingeschränkten Möglichkeiten zur Erzeugung von Energie im ganzen Sonnensystem. In der Praxis bedeutet das, dass sie derzeit nicht nutzbar sind - zumal die Fehlerquote der Transporte erschreckend hoch geworden ist. Das könnte aber eventuell mehr mit Nebenwirkungen der Hyperstürme als mit der Erhöhung der Hyperimpedanz zu tun haben. Ferntransmitter sind in jedem Fall noch stärker betroffen, so dass es keine Transmitterstraße nach Olymp mehr gibt. Erste Messungen weisen darauf hin, dass es offensichtlich eine »Transmissions-Reichweitenbegrenzung« gibt, die bei etwa fünf Lichtjahren liegt und auch für Transitionen gilt. Ob sich an diesem Grenzwert etwas durch neue Techniken oder eine bessere Energieerzeugung ändern lässt, bleibt abzuwarten.

Als »Transmitterabkömmlinge« sind dementsprechend auch Transformkanonen in Kernschussweite und Kaliberstärke deutlich reduziert. Nach bisherigen Erkenntnissen liegt die Reichweite bei einer Million Kilometern, die Kalibergröße bei maximal 500 Megatonnen Vergleichs-TNT

| Quellen: PR-Heft Nummer

2217 |

|

|